Contents

Top

Rechenprozesse am Netzwerkrand

Beliebte Inhalte zu Edge-Computing

Edge-KI und Maschinelles Lernen

Trainingsmethoden für maschinelles Lernen

Eingebettetes ML

Beliebte Inhalte zu Edge-KI

ML-Software (einschließlich TensorFlow und LiteRT)

TensorFlow

LiteRT

PyTorch und ExecuTorch

Beliebte Inhalte zu ML-Software

Edge-KI und ML-Hardware

Voraussetzungen

NPUs

TPUs

Produkte der Einstiegsklasse

Produkte der Mittelklasse

Produkte für Fortgeschrittene

Produkte für Experten

Weitere Produkte

Beliebte Inhalte zu Edge-KI-Hardware

Edge Impulse

Beliebte Inhalte zu Edge Impulse

Beliebte Hardware für Edge Impulse

Sensorik mit KI

Bildsensoren mit maschinellem Lernen

Beliebte Sensoren für KI-Bilderfassung

Beliebte Inhalte zu Sensoren für KI-Bilderfassung

Bewegungssensoren mit maschinellem Lernen

Beliebte KI-Bewegungssensoren

Beliebte Inhalte zu Bewegungssensoren

Umgebungssensoren mit maschinellem Lernen

Beliebte KI-Umgebungssensoren

Edge-KI

Edge-Computing ist genau das, wonach es klingt, Datenverarbeitung in der Nähe der Datenquelle, und der Gegensatz zum Cloud-Computing (das außerhalb des Standorts in einem Rechenzentrum stattfindet). Geräte wie ein intelligenter Haushaltsassistent (Alexa oder Siri) nutzen Edge-KI. Wenn Sie „Hey Alexa“ sagen, erkennt die Edge-KI diese Formulierung und weckt den intelligenten Heimassistenten auf.

Sehen Sie, wie KI und maschinelles Lernen die Art und Weise verändert haben, wie Systeme und Geräte Daten verarbeiten, und wie sie Entscheidungen in Echtzeit direkt an der Quelle treffen können, anstatt sich auf entfernte Server zu verlassen. Angesichts der rasanten technologischen Entwicklung ist das Verständnis und die Anwendung dieser Konzepte für die Entwicklung intelligenter, autonomer Systeme für die Entscheidungsfindung in Echtzeit in einer Reihe von Branchen von entscheidender Bedeutung. In diesem Magazin befassen wir uns mit der Hardware, der Software und einigen Anwendungen, bei denen Edge-KI und maschinelles Lernen eingesetzt werden und welche Probleme damit gelöst werden können.

Rechenprozesse am Netzwerkrand

Da der Bedarf an Computerdienstleistungen täglich steigt, mag die Abkehr von großen, zentralisierten Rechenzentren überraschend erscheinen. Die Datenverarbeitung näher an der Datenquelle kann jedoch die Bedenken hinsichtlich des Datenschutzes verringern. Der Netzwerkrand, früher die Domäne von Peripheriegeräten und Endgeräten, ist nun der Ort, an dem wir moderne Verarbeitungsfähigkeiten finden können.

Der Bedarf an Edge-Computing wird durch viele Echtzeitaktivitäten bestimmt. Diese Anwendungen finden sich möglicherweise auch schon in Ihrer Umgebung.

- Intelligente Hausassistenten (wie Alexa von Amazon, Google Assistant für Android-Geräte und Siri für Apple-Geräte) verwenden „Wake-Word“-Erkennung (Worte zur Aktivierung der Hardware) als eine Form des Edge-Computing. Edge-Computing ist in diesem Fall notwendig, weil die Geräte schnell reagieren und die Privatsphäre der Nutzer wahren müssen.

- Moderne Fahrerassistenzsysteme (ADAS), die sich auf Funktionen wie die Benachrichtigung des Fahrers beim Verlassen seiner Fahrspur konzentrieren, können nicht auf die Hin- und Rückübertragung in die Cloud warten oder eine verzögerte Netzantwort riskieren.

- Die Patientenüberwachung (z. B. durch Blutzuckermessgeräte) erfolgt in der Nähe des Patienten. Dabei dürfen Daten nur an das Smartphone des Patienten (oder ein lokales Gerät) gesendet werden, wodurch die Gefahr, dass geschützte Gesundheitsdaten ins Internet gelangen, verringert wird.

- Modelle für die vorausschauende Wartung erkennen Anomalien in der Vibrationsstärke von Industriemotoren, um zu ermitteln, wann die Motoren ausfallen werden. Es kann eine Warnung ausgelöst und anschließend an die Cloud gesendet werden, falls eine Anomalie entdeckt wird, aber die restliche Zeit analysiert die Software die Daten nur am Rande des Netzwerks (was die Netzwerküberlastung reduziert).

Was ist der Unterschied zwischen Edge-Computing und Cloud-Computing? Antwort anzeigen

Cloud-Computing bezieht sich häufig auf eine Reihe von Diensten in einem Rechenzentrum (in der Regel weit entfernt von dem Ort, an dem die Daten erzeugt werden). Cloud-Computing-Workloads werden auf Servern verarbeitet, auf denen CPUs (Central Processing Units) oder GPUs (Graphic Processing Units) eingesetzt werden.

Edge-Computing bezieht sich auf Dienste, die sich in der Nähe der zu generierenden Daten befinden. Edge-Computing-Workloads werden häufig auf Mikrocontrollern oder Einplatinencomputern (SBCs) verarbeitet.

Beliebte Inhalte zu Edge-Computing

Use Single-Board Computers to Create an IIoT Edge Computing Platform

Cloud-based data centers are important resources for the Industrial Internet of Things (IIoT), providing scalable mass storage, processing, analytics, regular attention to security, and continual functionality updates; but relying on the cloud for everything has several disadvantages.

Install Home Assistant and Set Up a Cost-Effective Smart Home Hub

Let’s take a look at the installation and setup process of Home Assistant on a cost and power-effective x86 single-board computer (SBC)

Edge-KI und Maschinelles Lernen

Künstliche Intelligenz (KI) und maschinelles Lernen (ML) bezeichnen im weitesten Sinne die Verwendung von Computeralgorithmen und statistischen Modellen, die die Leistung von Aufgaben ohne direkte ausdrückliche Anweisungen verbessern. Diese Möglichkeit, dass Entwickler nicht jede Aktion definieren müssen, ist eine Abkehr von der traditionellen Programmierung, die explizit definiert ist, und ermöglicht eine Selbstverbesserung und Anpassungsfähigkeit, die in fast allen Bereichen - von Empfehlungen für Internetinhalte und Spracherkennung bis hin zur Medizin und autonomen Fahrzeugen - neue Anwendungen findet.

Da immer mehr Systeme des täglichen Lebens ein gewisses Maß an ML-Interaktion aufweisen, ist das Verständnis dieser Welt für Ingenieure und Entwickler unerlässlich, um die Zukunft der Benutzerinteraktion zu verstehen.

Künstliche Intelligenz (KI) ist ein weites Feld, insbesondere das maschinelle Lernen (ML) ist ein Bereich, in dem wir für Anwendungen am Netzwerkrand die meisten Möglichkeiten sehen. Maschinelles Lernen ist ein Prozess, der auf der Grundlage eines statistischen Algorithmus einen Mustervergleich durchführt.

Die Verwendung von neuronalen Netzen ist eine gängige Trainingsmethode im Bereich des maschinellen Lernens. Die folgende Abbildung zeigt die Knoten und Gewichtungen in einem solchen Modell.

Deep Learning ist eine spezielle Art des maschinellen Lernens, die mehrere versteckte Schichten im neuronalen Netzwerk hat.

Was ist ein Modell für maschinelles Lernen? Antwort anzeigen

Ein Modell für maschinelles Lernen ist ein Softwareprogramm, das auf der Grundlage von Mustern, die in den Trainingsdaten gefunden wurden, Eingabedaten erkennen und sortieren soll. Durch die Verwendung von Trainingsdaten können ML-Modelle Muster aus den Daten extrahieren und diese Muster dann zur Vorhersage künftiger Ergebnisse und zur Verfeinerung präziserer Modelle verwenden.

Trainingsmethoden für maschinelles Lernen

Um ein funktionierendes ML-Modell zu erhalten, muss es trainiert werden. Es gibt verschiedene Lernmethoden, die zum Trainieren des Modells verwendet werden können.

- Supervised - ist eine Art des überwachten Trainings auf der Grundlage von gekennzeichneten und markierten (tagged) Beispieldaten, bei der die Ausgabe ein bekannter Wert ist, der auf seine Korrektheit überprüft werden kann, ähnlich wie ein Tutor, der die Arbeit auf dem Weg korrigiert. Diese Art von Training wird in der Regel bei Anwendungen wie Klassifizierung oder Datenregression eingesetzt. Überwachtes Training kann sehr nützlich und hochpräzise sein, aber es hängt stark von dem markierten Datensatz ab und ist möglicherweise nicht in der Lage, neue Eingaben zu verarbeiten.

- Unsupervised - anstelle von gekennzeichneten Trainingsdaten mit definierten Ausgaben werden beim unüberwachten Training Lernalgorithmen verwendet, um Datencluster aus nicht gekennzeichneten Datensätzen zu untersuchen, zu analysieren und zu finden. Typischerweise wird unüberwachtes Training in Anwendungen eingesetzt, bei denen große Datensätze untersucht und Beziehungen zwischen Datenpunkten gefunden werden müssen.

- Semi-supervised - ist eine Mischung aus überwachtem und nicht überwachtem Training. Der Trainingsdatensatz enthält sowohl markierte als auch unmarkierte Daten. Das halbüberwachte Training kann zwar ein breiteres Spektrum an Eingabedaten verarbeiten als andere Methoden, es kann jedoch komplexer sein als das überwachte oder unüberwachte Training, und die Qualität der nicht markierten Daten kann die Genauigkeit des endgültigen Modells beeinträchtigen.

- Reinforcement Learning from Human Feedback (RLHF) - dieses verstärkende Training ist eine Art des Trainings, das die Verwendung klar definierbarer Aktionen erfordert, die es ausführen kann, zusammen mit Leistungskennzahlen und einem Ergebnis, das bewertet und verbessert werden kann. Durch die Definition des Regelsatzes und der möglichen Aktionen kann das verstärkende Training dann kontinuierlich wiederholt werden, um verschiedene Handlungsoptionen zur Erreichung der Zielbedingungen zu bewerten.

Eingebettetes ML

Eingebettetes ML ist ein Teilbereich des maschinellen Lernens, das sich auf die Ausführung von Modellen konzentriert, und folgende Merkmale aufweist:

- geringe Latenzzeit (kein Warten auf Server-Antworten und keine Netzwerklatenz durch die Verbindung zu den Servern)

- geringe Bandbreite (keine Übertragung von hochauflösenden Daten über das Netz)

- geringe Leistung (mW statt W)

Anstatt sich auf große Datenverarbeitungshardware (wie Server oder PCs) zu verlassen, können eingebettete ML-Modelle auf kleinen, stromsparenden Geräten (wie Mikrocontrollern, FPGAs und DSPs) eingesetzt werden.

Das Training eines Modells für eine eingebettete ML-Anwendung kann auf einem Server oder Computer erfolgen. Dies ist ein Prozess, bei dem alle Daten eingespeist werden und ein daraus resultierendes Modell erstellt wird.

Sobald ein eingebettetes ML-Modell erstellt ist, kann es auf einem eingebetteten System ausgeführt werden. Zu den üblichen Anwendungen von Embedded ML gehören die Erkennung und Aktivierung durch ein Aufweckwort, die Identifizierung von Personen oder Objekten oder das Auffinden von Anomalien auf der Grundlage eines Datenstroms von einem Sensor.

Was sind die Vorteile von Edge-KI (oder Embedded ML)? Antwort anzeigen

- Geringe Latenzzeit: Kein Warten auf entfernte Server und keine Netzwerklatenz

- Geringe Datenbandbreite: Keine Übertragung oder Rücksendung großer Mengen hochauflösender Daten über Netzwerke

- Datenschutz: Entscheidungen in den Endgeräten zusammen mit vorgefilterten Sensorausgaben, Daten müssen nicht über das Internet verbreitet werden

- Geringer Stromverbrauch: Embedded ML verbraucht Strom in Milliwatt statt in Watt und ist damit ideal für batteriebetriebene mobile Geräte.

- Kleiner Daten-Footprint: Eingebettetes ML ist so konzipiert, dass es in kleine Flash-Speicher passt, in der Größenordnung von 10 Kilobyte.

- Ökonomische und kostengünstige Geräte: Eingebettetes ML kann lokal auf einer 32-Bit-MCU genutzt werden, wobei die gesamten Systemkosten oft unter 50 EUR liegen.

Beliebte Inhalte zu Edge-KI

What is Edge AI? Machine Learning + IoT

The term “Edge AI” might be the new buzzword, much like “Internet of Things” was in 2016/2017. To understand this growing new trend, we need to provide a solid definition of what constitutes “Artificial Intelligence on the Edge.”

TinyML: Getting Started with TensorFlow Lite for Microcontrollers

TensorFlow is a popular open source software library (developed by Google) for performing machine learning tasks. A subset of this library is TensorFlow Lite for Microcontrollers, which allows us to run inference on microcontrollers

ML-Software (einschließlich TensorFlow und LiteRT)

TensorFlow

Bezugsquelle: https://www.tensorflow.org/

Bezugsquelle: https://www.tensorflow.org/

TensorFlow ist eine freie und quelloffene Softwarebibliothek für die Erstellung, das Training und den Einsatz von Modellen für maschinelles Lernen. Ursprünglich von Google für das Projekt „Google Brain“ im Jahr 2011 entwickelt, wurde es 2015 für die Öffentlichkeit freigegeben und die aktualisierte und aktuelle Version TensorFlow 2.0 wurde 2019 veröffentlicht.

TensorFlow ist das beliebteste und am weitesten verbreitete Bezugssystem für maschinelles Lernen, Training und Inferenz (Schlussfolgerung) von tiefen neuronalen Netzen. Viele Entwickler interagieren mit TensorFlow über seine Python-API-Bibliothek, aber TensorFlow ist auch kompatibel mit den Programmiersprachen Java, JavaScript und C++. Pakete von Drittanbietern erweitern die Möglichkeiten, so dass fast alles aus MATLAB, R, Haskell, Rust und anderen Programmiersprachen verwendet werden kann.

LiteRT

Quelle: Google Developers Blog

Quelle: Google Developers Blog

LiteRT (RT steht hier für Run-Time), früher bekannt als TensorFlow Lite, ist eine Teilmenge von TensorFlow, die für die Arbeit in kleinem Maßstab entwickelt wurde. Dazu gehören Geräte mit begrenzter Hardware und eingeschränktem Stromverbrauch wie eingebettete Systeme, mobile Geräte und Edge-Computing-Geräte. Ein Entwickler kann ein bestehendes ML-Modell in TensorFlow trainieren, erstellen oder modifizieren und es dann mit LiteRT in ein kleineres und effizienteres Softwarepaket konvertieren, das es ermöglicht, es auf mobilen Geräten auszuführen.

Nach der Bereitstellung auf der Mikrocontroller-Plattform findet jedoch in der Regel kein weiteres Training für das ML-Modell auf dem Gerät statt, da dies zu viel Rechenleistung und Zeit erfordert, um es lokal durchzuführen. Dies bedeutet, dass das Modell in der Regel vollständig offline trainiert wird, ohne dass neue Datenquellen hinzukommen. Dieser begrenzte Ansatz eignet sich hervorragend für Anwendungen, die nur eine einzige Aufgabe erfüllen. Sie müssen jedoch eine große Anzahl von Daten sortieren.

Was ist der Unterschied zwischen TensorFlow und LiteRT? Antwort anzeigen

TensorFlow erfordert größere Computerhardware und ein vollständiges GPOS (General Purpose Operating System).

LiteRT ist für die Ausführung von ML-Modellen auf eingebetteten Systemen, mobilen Geräten und Edge-Computing-Geräten optimiert.

Einplatinencomputer wie der Arduino Uno, das BeagleBoard von TI, Espressif ESP32 und der Raspberry Pi 4, die ein GPOS verwenden, können das volle TensorFlow auf einem entsprechend großen Speicher laufen lassen. Seien Sie sich aber bewusst, dass der Stromverbrauch typischerweise viel höher ist als bei einer MCU oder einem DSP und normalerweise bei 10 bis 20 Watt liegt.

Im Allgemeinen wird das Training der Modelle mit TensorFlow durchgeführt, und damit das Modell auf einem leichtgewichtigen eingebetteten System läuft, wird es in LiteRT konvertiert.

PyTorch und ExecuTorch

Um dem wachsenden Bedarf an ML-Modellen auf lokalisierten Hardware-Plattformen gerecht zu werden, hat PyTorch ExecuTorch entwickelt, ein vollständiges Software-Tool zur Ausführung von Modellen für maschinelles Lernen auf Smartphone-Wearables und Embedded-Plattformen. ExecuTorch ist in der Lage, die gleichen Toolchains und das SDK (Software-Development-Kit) wie das reguläre PyTorch zu verwenden, von der Modellierung bis zur Konvertierung und Bereitstellung, und ist außerdem mit einer breiten Palette von CPU-, NPU- und DSP-Plattformen kompatibel.

ExecuTorch wurde mit PyTorch 2.0 entwickelt, was es benutzerfreundlich macht und von einer breiten Palette von Geräten unterstützt wird, einschließlich Android-Unterstützung für Smartphone-Anwendungen.

Was unterscheidet PyTorch Edge von ExecuTorch und PyTorch Mobile? Antwort anzeigen

PyTorch Edge ist das Konzept der Ausführung eines ML-Modells am Netzwerkrand (Edge). PyTorch Mobile ist das Legacy-Toolset, mit dem dies erreicht wurde, und ExecuTorch ist das moderne Toolset zur Ausführung eines PyTorch-Modells am Netzwerkrand.

PyTorch Mobile war ein früherer Versuch, PyTorch auf mobile Geräte, insbesondere iOS-, Android- und Linux-basierte Geräte, zu übertragen, war aber dadurch eingeschränkt, dass beim Start der Anwendung ein statischer Speicherbedarf erforderlich war. Im Gegensatz dazu nutzt ExecuTorch den Speicher dynamisch, d. h., es wird nur der Speicherplatz belegt, der gerade benötigt wird. Dies ist ein entscheidender Vorteil in Umgebungen mit begrenzter Speicherkapazität.

Kann ich mein TensorFlow-Modell auf PyTorch laufen lassen (und umgekehrt)? Antwort anzeigen

Obwohl TensorFlow und PyTorch ähnliche Softwareumgebungen sind, sind sie derzeit nicht direkt miteinander kompatibel. Aufgrund der unterschiedlichen Trainingsmethoden und Modelldateien, die jedes System verwendet, ist es schwierig, ein Modell von einem Ökosystem auf ein anderes zu übertragen.

Glücklicherweise gibt es eine weitere Option, die die Umstellung zwischen den beiden Systemen erleichtert. ONNX oder Open Neural Network Exchange ist ein quelloffenes ML-Softwaresystem, das ein Tool für die Konvertierung von Trainingsmodelldateien zwischen ML-Ökosystemen enthält.

ONNX fungiert als Zwischenschritt zwischen ML-Ökosystemen und ermöglicht es Entwicklern, mit vielen verschiedenen ML-Trainingsmethoden zu arbeiten und Modelle mit einer Reihe von Methoden zu optimieren.

Beliebte Inhalte zu ML-Software

TensorFlow Lite Tutorial Part 1: Wake Word Feature Extraction

Machine Learning (ML) is gaining increasing traction in the tech community, and TensorFlow is one of the most popular framework. Using embedded devices for ML is a subset of TensorFlow, called “TensorFlow Lite” and has been released to run inferences of models on smaller, low power devices like single board computers.

How to Perform Object Detection with TensorFlow Lite on Raspberry Pi

In this tutorial, I’ll walk you through the process of installing TensorFlow Lite on a Raspberry Pi and using it to perform object detection with a pre-trained Single Shot MultiBox Detector (SSD) model.

TensorFlow Lite for Microcontrollers Kit Quickstart

Machine learning has come to the 'edge' - small microcontrollers that can run a very miniature version of TensorFlow Lite to do ML computations. But you don't need super complex hardware to start developing your own TensorFlow models! We've curated a simple kit to dip your toes into machine learning waters.

Edge-KI und ML-Hardware

„TensorFlow Lite for Microcontrollers“ ist eine Softwareplattform für maschinelles Lernen, die für Anwendungen auf Mikrocontrollern entwickelt wurde. Der Verzicht auf Betriebssysteme, C- oder C++-Bibliotheken oder Anwendungen mit dynamischem Speicher machen „TensorFlow Lite for Microcontrollers“ klein, aber deutlich leistungsfähiger als Standardprogrammieroptionen.

Warum Edge-KI auf einem Mikrocontroller nutzen? Antwort anzeigen

Mikrocontroller sind kleine, flexible, stromsparende und kostengünstige Optionen, die in Milliarden von Geräten weltweit zu finden sind. Mikrocontroller sind von Vorteil, wenn kein vollständiges Computersystem erforderlich ist. Mikrocontroller sind von besonderem Interesse für den Bereich ML, die Fähigkeit, Entscheidungen zu treffen und eingehende Daten lokal zu verarbeiten. Ein zusätzlicher Vorteil der lokalen Datenverarbeitung besteht darin, dass die Privatsphäre der Endnutzer geschützt werden kann. Sie möchten zum Beispiel wissen, ob sich jemand Ihrer Haustür nähert, ohne dass Sie die Videodaten Ihrer Türklingel in der Cloud speichern müssen.

Voraussetzungen

„TensorFlow Lite for Microcontrollers“ wurde in der Programmiersprache C++17 entwickelt und benötigt eine 32-Bit-Mikrocontroller-Plattform.

Der Software-Kern von „TensorFlow Lite for Microcontrollers“ kann auf der ARM-Cortex-M-Plattform mit nur 16 kB Speicher laufen. Er wurde darüber hinaus auch auf die beliebte EPS32-Plattform portiert. Es gibt sogar eine Arduino-Softwarebibliothek für das Framework „TensorFlow Lite for Microcontrollers“, falls Sie lieber mit einer geeigneten Arduino-Plattform arbeiten.

Was sind die Grenzen von „TensorFlow Lite for Microcontrollers“? Antwort anzeigen

Obwohl „TensorFlow Lite for Microcontrollers“ eine leistungsfähige Plattform für maschinelles Lernen ist, die mit den kleinsten Hardwareanforderungen arbeiten kann, gibt es eine Reihe von Einschränkungen, die die Entwicklung schwierig machen können:

- Offizielle Unterstützung ist nur für eine kleine Anzahl von Geräten verfügbar, in der Regel leistungsstarke 32-Bit-Plattformen

- Wie bei TensorFlow Lite wird das Training auf dem Mikrocontroller nicht unterstützt.

- Es wird nur eine kleine Teilmenge der grundlegenden TensorFlow-Operationen unterstützt.

- Für die Speicherverwaltung kann eine anwendungsspezifische Low-Level-C++-Programmierschnittstelle (API) erforderlich sein.

Andere eingebettete Systeme

Durch den Einsatz von ML-Modellen auf leistungsstärkeren Hardwaresystemen, auf denen Embedded Linux ausgeführt werden kann, oder auf einem Einplatinencomputer wie dem Raspberry Pi kann auch die TensorFlow-Lite-Plattform ausgeführt werden.

Hardware-Beschleuniger

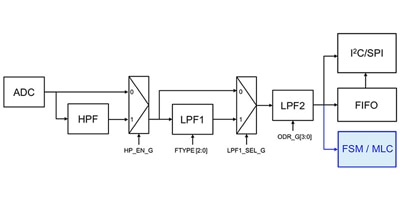

Auf Chipebene werden bestimmte Prozessoren mit mehr spezieller arithmetischer Logik ausgestattet, um die Mathematik für das maschinelle Lernen und die verwendeten neuronalen Netze zu unterstützen.

NPUs

NPUs (Neural Processing Units) sind spezialisierte ICs, die die Verarbeitung von Anwendungen des maschinellen Lernens und der künstlichen Intelligenz, die auf neuronalen Netzen basieren, beschleunigen sollen.

Neuronale Netze sind dem menschlichen Gehirn nachempfundene Strukturen mit vielen miteinander verbundenen Schichten und Knoten, den so genannten Neuronen, die Informationen verarbeiten und weitergeben.

TPUs

TPUs (Tensor Processing Units) sind spezialisierte ICs, die 2015 von Google entwickelt wurden und die Verarbeitung von auf neuronalen Netzen basierenden Systemen unterstützen sollen. Im Gegensatz zu NPUs geschieht dies jedoch nicht mit einer auf Neuronen basierenden Systemarchitektur, sondern durch die schnelle Verarbeitung von Matrixmultiplikationen und Faltungsoperationen.

TPUs sind hochgradig für die Verarbeitung mathematischer Matrixoperationen bei geringem Energieverbrauch optimiert, was sie ideal für das Training von ML-Modellen macht, die solche Operationen verwenden, wie TensorFlow und ExecuTorch.

Die ersten Generationen von TPU-Hardware werden aufgrund ihrer Anforderungen an die Stromversorgung und Kühlung in der Regel nur in Rechenzentren eingesetzt. Die neueste Generation von TPUs ist jedoch auch für Anwendungen am Netzwerkrand konzipiert.

Warum werden CPUs und GPUs in der Edge-KI nicht häufiger eingesetzt? Antwort anzeigen

Herkömmliche Zentralrechnereinheiten (CPUs) eignen sich hervorragend für allgemeine Operationen, sind aber nicht dafür optimiert, die gesamte Arithmetik neuronaler Netze effizient zu verarbeiten. Grafikprozessoren (GPUs) sind ebenfalls sehr nützlich für Anwendungen des maschinellen Lernens und der künstlichen Intelligenz, doch der hohe Energieverbrauch und die benötigte Hardware schränken ihren Einsatz am Netzwerkrand ein.

Produkte der Einstiegsklasse

![]()

Das PicoBoard von Raspberry Pi ist ein kostengünstiges und dennoch flexibles Entwicklungsboard für den von Raspberry Pi selbst entwickelten Mikrocontroller-Chip RP2040.

![]()

Mit der Portenta-Familie von Arduino lässt sich das Arduino-Ökosystem besser nutzen, um leistungsstarke KI-Algorithmen und maschinelles Lernen am Netzwerkrand einzusetzen.

![]()

Entwicklungsboards der Serie XIAO

Die Entwicklungsboards der Serie XIAO von Seeed Studio sind nur einseitig bestückt und lassen sich so leicht in andere Platinen integrieren.

Produkte der Mittelklasse

![]()

Die STM32N6 von STMicroelectronics basiert auf dem Arm® Cortex®-M55, der mit 800 MHz läuft. Der Cortex-M55 ist die erste CPU, die mit der Helium-Technologie von Arm ausgestattet ist.

![]()

Mikrocontroller der Serie MCX-N

![]()

Das Multicore-Design der Mikrocontroller der Serie MCX-N von NXP verbessert die Systemleistung und reduziert den Stromverbrauch.

![]()

Der Raspberry Pi 5basiert auf einem 64-Bit-Vierkern-Prozessor mit 2,4-GHz-Arm®-Cortex®-A76, der im Vergleich zum Raspberry Pi 4 eine zwei- bis dreifach höhere CPU-Performance bietet.

Produkte für Fortgeschrittene

![]()

STM32MP25-Anwendungsprozessoren der zweiten Generation – demnächst verfügbar

Die STM32-Mikroprozessoren der zweiten Generation von STMicroelectronics ermöglichen sichere Rechenleistung und hochentwickelte Edge-KI in industriellen Anwendungen.

![]()

Extrem energieeffizienter Arm®-Cortex®-M4-Prozessor MAX78000 mit neuronalem Netzwerkbeschleuniger

Der MAX78000 von Analog Devices ist eine neue Generation von KI-Mikrocontrollern, die es neuronalen Netzwerken ermöglichen, mit extrem niedriger Leistung und am Rande des IoT zu arbeiten.

![]()

MCU der 32-bit STM32 F7-Serie mit ARM® Cortex™-M7-Kern

Die MCU der STM32 F7-Serie arbeitet bei Frequenzen bis zu 200 MHz und nutzt eine 6-stufige superskalare Pipeline und eine Fließkommaeinheit (FPU), um bis zu 1000 CoreMarks zu erzeugen.

Produkte für Experten

![]()

Entwicklungskit NVIDIA® Jetson Nano™

Das Entwicklungskit NVIDIA® Jetson Nano™ von Seeed bietet die Leistung, um moderne KI-Aufgaben (künstliche Intelligenz) effizient und in einem kleinen Formfaktor auszuführen.

![]()

Die NVIDIA® Jetson-Komplettplattformen von Seeed verbessern die Entwicklung von Anwendungen in den Bereichen künstliche Intelligenz (KI), verteilte Datenverarbeitung und Embedded.

Weitere Produkte

Beliebte Inhalte zu Edge-KI-Hardware

Practical Development Board Resources for Edge AI System Development

This video delves into the shift from “centralized intelligence” to “distributed intelligence,” introducing applications of TinyML and local offline AI.

Edge Impulse

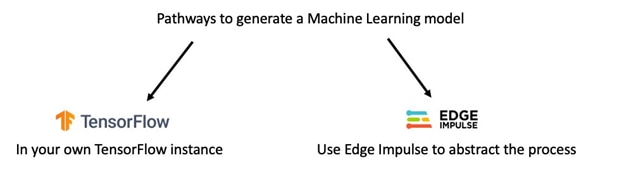

Edge impulse ist eine Cloud-basierte, integrierte Entwicklungsumgebung (IDE), die es Softwareentwicklern ermöglicht, reale Daten zu sammeln und zu importieren, ML-Modelle zu erstellen, zu trainieren und zu testen, die dann effizient auf Geräten am Netzwerkrand ausgeführt werden können.

Der Unterschied zwischen Edge Impulse und TensorFlow-Software für maschinelles Lernen: Mit Edge Impulse ist der Modellentwicklungsprozess vom Benutzer abstrahiert, während die Entwicklung mit TensorFlow ein viel aufwändigerer Prozess ist.

Der Unterschied zwischen Edge Impulse und TensorFlow-Software für maschinelles Lernen: Mit Edge Impulse ist der Modellentwicklungsprozess vom Benutzer abstrahiert, während die Entwicklung mit TensorFlow ein viel aufwändigerer Prozess ist.

Die Vorteile von Edge Impulse

Das Framework von Edge Impulse kann mit allen Daten arbeiten, von Audio (von Mikrofonen) über Bilder (von Kameras) bis hin zu Sensordaten (z. B. von Schwingungssensoren). Einige weitere Beispiele sind:

- Objekterkennung und Bilderfassung (z. B. zur Erkennung von Personen)

- „Weckwörter“ über Audioerkennung (für Smart-Home-Assistenten)

- Erkennung von Anomalien (zur vorbeugenden Wartung)

- Erkennung von Aktivitäten/Mustern (zur Optimierung von Prozessen)

Warum sollte ich Edge Impulse verwenden? Antwort anzeigen

Edge Impulse kann den Arbeitsaufwand für die ML-Trainingssoftware (bei der es sich derzeit hauptsächlich um TensorFlow handelt) verringern. Edge Impulse bietet eine webbasierte Schnittstelle, über die Daten mit Tags versehen und hochgeladen werden können, um das Modell zu trainieren.

Edge impulse wurde für Erstanwender oder Nicht-ML-Entwickler entwickelt, die noch nie ML-Trainingssoftware verwendet haben, aber es ist auch für Experten voll erweiterbar, da es mit dem Python-Framework für TensorFlow kompatibel ist. Durch die Beseitigung eines Großteils der Codierungshürde bei der Erstellung von Edge-KI-Modellen kann man sich mehr auf die Bereitstellung der richtigen Daten bzw. das Training des richtigen Modells konzentrieren und weniger auf die Frage, welche Python-Bibliotheken zur Ausführung des Codes eingebunden werden sollten.

Zwar gibt es für die meisten Entwickler und Nutzer eine kostenlose Nutzungsebene, doch ist die Anzahl der Projekte und die Rechenleistung, die jedes Projekt nutzen kann, begrenzt. Für professionelle Entwickler gibt es eine kostenpflichtige Ebene, über die der Preis für Edge Impulse je nach Verwendung festgelegt wird.

Beliebte Inhalte zu Edge Impulse

Lego Brick Finder with OpenMV and Edge Impulse

In this tutorial, Shawn shows you how OpenMV and Edge Impulse trained for image recognition can be used to create Lego® brick finder.

Getting Started with the OpenMV Cam: Machine Vision with MicroPython

In this tutorial, Shawn shows you how to get started with the OpenMV H7 camera module, which uses MicroPython to perform a variety of machine vision tasks

Car Parking Detection System Using Edge Impulse

In this example project, we have built an object detection model to detect the number of cars in a parking lot and deploy it on a Raspberry Pi 4.

Beliebte Hardware für Edge Impulse

![]()

IoT-Prototyping-Plattform Nordic Thingy:53

![]()

Das Nordic Thingy:53 von Nordic Semiconductor bietet integrierte Bewegungs-, Schall-, Licht- und Umgebungssensoren zur Erstellung von Machbarkeitsstudien und Prototypen.

![]()

![]()

Das Entwicklungskit MG24 von Silicon Labs bietet hohe Leistung, 2,4-GHz-HF und einen geringen Stromverbrauch.

Eine vollständige Liste der mit Edge Impulse kompatiblen Boards finden Sie hier: Übersicht der mit Edge Impulse kompatiblen Edge-KI-Hardware

Sensorik mit KI

Obwohl für die Ausführung eines Modells des maschinellen Lernens ein eingebettetes System erforderlich ist, wird es immer mehr Produkte geben, die als KI-fähige elektronische Komponenten auf den Markt kommen. Dazu gehören auch KI-fähige Sensoren, die auch als Sensoren für maschinelles Lernen bekannt sind.

Was Sensoren für maschinelles Lernen leisten können

Während die meisten Sensoren durch das Hinzufügen eines Modells für maschinelles Lernen nicht effizienter werden, gibt es einige Arten von Sensoren, die durch ML-Training wesentlich effizienter arbeiten können.

- Kamerasensoren, für die maschinelle Lernmodelle entwickelt werden können, um Objekte und Personen im Bild zu verfolgen.

- Trägheitsmesseinheiten, Beschleunigungsmesser und Bewegungssensoren zur Erfassung von Aktivitätsprofilen.

Bildsensoren mit maschinellem Lernen

Durch die Verwendung neuronaler Netze zur Bereitstellung spezieller Rechenalgorithmen ist es möglich, Objekte und Personen zu erkennen und zu verfolgen, während sie sich in das Sichtfeld des Kamerasensors bewegen.

Beliebte Sensoren für KI-Bilderfassung

![]()

Offline-Edge-AI-Schwerkraft-Gesten-/Gesichtserkennungssensor

Der DFRobot-Sensor ermöglicht eine Offline-KI-Gesten- und Gesichtserkennung, die 5 Handgesten und bis zu 10 Gesichter in einem Umkreis von 3 Metern erkennt für eine private Verwendung ohne Cloud-Nutzung.

![]()

Kameramodul-Bundle B-CAMS-OMV für STM32-Boards

Das Kameramodul-Bundle B-CAMS-OMV von STMicroelectronics besteht aus einem 5-MPixel-Kameramodul mit einer Adapterplatine inklusive Erweiterungssteckverbindern.

![]()

Intelligente Sensorik mit Nicla-Familie von Arduino

Die Nicla Boards von Arduino sind auf eine nahtlose und einfache Integration von energiesparender KI und maschinellem Lernen in aktuelle Konfigurationen ausgelegt.

Beliebte Inhalte zu Sensoren für KI-Bilderfassung

AI Vision Modules - Electronics with Becky Stern

AI vision boards allow you to incorporate features like face, person, and object recognition into your projects.

Introducing the Arduino Nicla Vision Board for Professional Machine-Vision Applications

This article focuses on the main features and specifications of the Arduino Nicla Vision, a compact industrial-grade board that has the potential to drive professional machine-vision applications.

Bewegungssensoren mit maschinellem Lernen

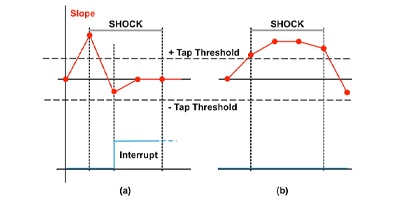

Bewegungssensoren mit integrierten maschinellen Lernplattformen sind in der Lage, Daten in Echtzeit zu verfolgen und zu verarbeiten, und zwar im selben Gehäuse wie der Sensor, was den Stromverbrauch und die Verarbeitungszeit reduziert. Die meisten Sensoren dieser Art verfügen entweder über einen kleinen logikbasierten Entscheidungsbaum oder über die Möglichkeit, Filter- oder Auslöseschwellen vorzudefinieren. Wenn also Eingabewerte vordefinierte Schwellen überschreiten, werden bestimmte Aktionen ausgeführt. Andere Bewegungssensoren enthalten eine komplette DSP-Einheit, die es ermöglicht, mehrere ML-Algorithmen ohne die primäre CPU laufen zu lassen, was Energie und Zeit spart.

Beliebte KI-Bewegungssensoren

![]()

Selbstlernender intelligenter KI-Sensor BHI260AP

Der selbstlernende KI-Sensor BHI260AP von Bosch Sensortec eignet sich für Anwendungen wie Unterhaltungselektronik, Wearables, Hearables und mehr.

![]()

Intelligente Trägheitsmesseinheit BHI385: Eingebettete KI für hochdynamische Bewegungserfassung

Die voll programmierbare Trägheitsmesseinheit BHI385 von Bosch Sensortec verfügt über einen Beschleunigungsmesser mit erweitertem g-Bereich, integrierte künstliche Intelligenz und einen extrem niedrigen Stromverbrauch.

Beliebte Inhalte zu Bewegungssensoren

Use a Smart Sensor’s Built-In Machine Learning Core to Optimize “Always-On” Motion Tracking

The emergence of low-power sensors with built-in motion detection capabilities helps developers eliminate this compromise in their designs.

Do You Really Need All That Raw Sensor Data? No! There’s a Better Way

Sensor systems can capture macro events that are deconstructed to an extended sequence of measurements with astounding levels of detail. Even the most ardent data junkie will nevertheless admit that massive amounts of raw data by themselves don’t advance the objectives of the application.

Umgebungssensoren mit maschinellem Lernen

Umgebungssensoren mit integrierten maschinellen Lernplattformen verarbeiten Daten in Echtzeit und bieten darüber hinaus auch maschinelle Lernverfahren. Die meisten Sensoren dieser Art suchen nach Veränderungen der Umgebungswerte, z. B. nach einem schnellen Temperaturanstieg, der darauf hinweisen kann, dass eine Kühlanlage ausgefallen ist.

Beliebte KI-Umgebungssensoren

![]()

KI-Umweltsensor Fermion BME688

Der KI-Umweltsensor Fermion BME688 von DFRobot ist ein kompakter MEMS-Sensor, der genaue Messungen von Temperatur, Luftfeuchtigkeit und Luftdruck liefert.

Quelle:

Quelle:  Quelle:

Quelle:  Quelle:

Quelle:  Quelle:

Quelle: